Co się stanie z naszą pracą?

W spektaklu „The Employees”, przygotowanym przez Łukasza Twarkowskiego z Joanną Bednarczyk w warszawskim Teatrze Studio, jest scena, która nawet niecały rok po obejrzeniu przedstawienia nie daje mi spokoju – jawi się bowiem jako najdoskonalsza diagnoza pułapki, w którą wpadło współczesne społeczeństwo. Pomiędzy aktami odbywa się rozmowa zautomatyzowanych reflektorów, tak zwanych głów (automatyzacja polega na wykonywaniu zaprogramowanych wcześniej ruchów, co daje im przewagę nad statycznymi reflektorami „starego typu”). Jako że spektakl przedstawia wizję przyszłości, urządzenia są bytami świadomymi, a wręcz nastawionymi krytycznie wobec rzeczywistości, w której przyszło im funkcjonować. W poufnej rozmowie prowadzonej pod nieobecność zespołu aktorskiego kwestionują więc zasadność swojej pracy, brak jej należytego docenienia ze strony publiczności, narzekają na warunki zatrudnienia. Słyszący tę rozmowę olbrzymi żyrandol, który jest głównym źródłem oświetlenia widowni, udziela reflektorom reprymendy. W krótkiej, ale wyjątkowo ostrej wypowiedzi zwraca ich uwagę na fakt, że w teatrze jest w efekcie ich zautomatyzowanej pracy kilkaset bezrobotnych reflektorów, więc powinny cieszyć się ze swojej pozycji. Zganione automaty szybko kończą narzekania, a spektakl rusza dalej, przenosząc uwagę publiczności na opowieść o tym, jak replikanci powoli zastępują ludzi nie tylko w pracy, ale również w sferach intymnych i emocjonalnych.

Scena ta przypomina mi, że opisywany już przez Karola Marksa w trzynastym rozdziale „Kapitału” lęk przed rozwojem technologii i idącą z nim w parze automatyzacją wykonywanej (jeszcze) przez człowieka pracy stanowi jedną z podstawowych pułapek turbokapitalizmu. To właśnie zagospodarowanie tego lęku przynoszą rozmaite narracje o konieczności adaptacji człowieka do nowych warunków zatrudnienia. W ich efekcie stworzony przez ludzi system wymaga od nas legitymizacji naszego własnego istnienia poprzez udowadnianie naszej dlań przydatności.

Początek roku to dla wielu osób czas postanowień, a więc de facto spekulacji na temat przyszłości. Zamiast więc poszukiwać sposobów zrozumienia, co się może stać z naszą pracą w nadchodzącym czasie, poprzez analityczne spojrzenie w przeszłość postanowiłem również oddać się temu noworocznemu spekulatywnemu trendowi. W tym celu sięgnąłem do prawdopodobnie najważniejszej i najczęściej komentowanej w minionym roku zdobyczy technologicznej, by niejako dowiedzieć się u źródła, jak może wyglądać przyszłość naszej pracy.

M.M.: Powiedz mi, proszę, jak może wyglądać przyszłość pracy w kontekście coraz szybciej rozwijającej się technologii?

ChatGPT[1]: Pytanie o przyszłość pracy w kontekście rozwijającej się technologii to temat z obszaru filozofii, ekonomii i futurologii. Istnieje wiele różnych perspektyw na ten temat, i wciąż trudno jednoznacznie przewidzieć, jak sytuacja się rozwinie. Niemniej jednak mogę przedstawić kilka ogólnych spostrzeżeń.

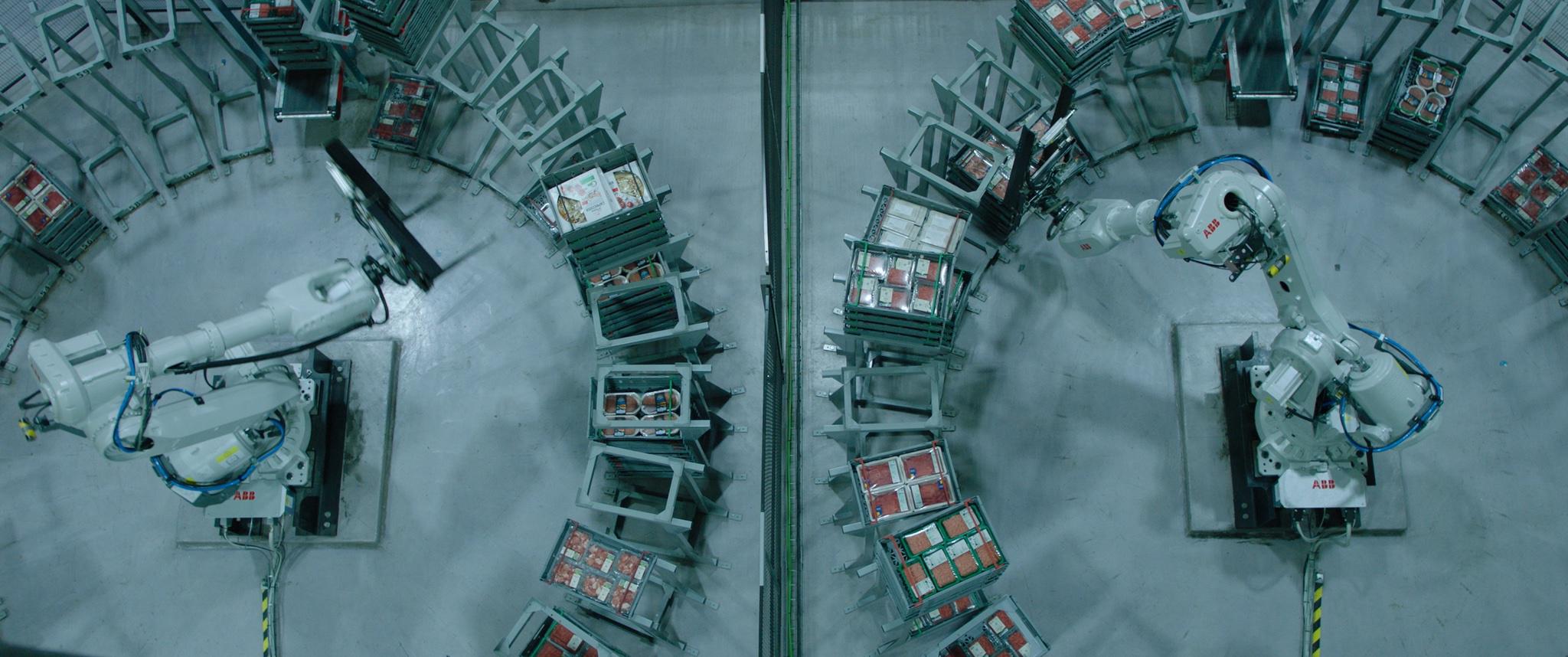

1) Automatyzacja i technologia: Rozwój technologii, w tym sztuczna inteligencja i robotyka, z pewnością zmieni charakter wielu miejsc pracy. Automatyzacja może prowadzić do zastąpienia niektórych czynności wykonywanych przez ludzi przez maszyny. Przykłady to roboty w produkcji, programy do analizy danych itp.

2) Nowe rodzaje pracy: Z drugiej strony rozwój technologii może również generować nowe rodzaje pracy, które wcześniej nie istniały. Powstają nowe dziedziny związane z obszarami technologicznymi, co może stworzyć miejsca pracy dla ludzi w tych nowych sektorach.

3) Ewolucja koncepcji pracy: Idea pracy może się również zmieniać. Może pojawić się więcej elastycznych form zatrudnienia, takich jak praca zdalna, a ludzie mogą bardziej skoncentrować się na kreatywności, innowacjach i zadaniach wymagających ludzkiego myślenia, których trudno zautomatyzować.

4) Wyzwania społeczne: Jednak istnieją również obawy związane z utratą miejsc pracy i nierównością społeczną. Konieczne może być dostosowanie systemów edukacji i społecznych, aby pomóc ludziom przystosować się do zmian.

W skrócie, przyszłość pracy prawdopodobnie będzie wynikiem kombinacji automatyzacji, tworzenia nowych miejsc pracy i zmian w podejściu do samego konceptu pracy. Warto śledzić rozwój technologii, społeczne i ekonomiczne trendy, aby lepiej zrozumieć, jak świat pracy może ewoluować.

Jak widać, tak zwana sztuczna inteligencja również podziela obawy związane z zastąpieniem człowieka przez maszynę. Chociaż może w jej przypadku trudno mówić o obawach. Z jednej strony dostrzeganie autonomicznych emocji w wytworach technologicznych wiąże się ze zbytnią ich antropomorfizacją, a ta sprawia, że przestajemy dostrzegać towarzyszące im zagrożenia (polegające chociażby na utracie podstawowych umiejętności społecznych, opierających się na krytycznej refleksji czy budowaniu bardziej złożonych wypowiedzi). Z drugiej – nawet gdybyśmy przyjęli, że zapytany przeze mnie model językowy mógłby odczuwać emocje, to dlaczego miałby się martwić, skoro dlań ta perspektywa nie niesie żadnych zagrożeń?

Myślę jednak, że o obawach ze strony tak zwanej sztucznej inteligencji trudno mówić z jeszcze jednego, bardziej podstawowego powodu. Wszak samo sformułowanie jest błędnie użyte – nie mamy do czynienia z żadną „sztuczną” inteligencją. Udostępniona przez firmę Open AI aplikacja ChatGPT to jeden z najbardziej rozpoznawalnych wielkich modeli językowych (Large Language Models, czyli LLM) – są to modele matematyczne, które wykorzystują głębokie uczenie maszynowe, a więc opierają się na statystyce, algebrze liniowej, rachunku prawdopodobieństwai rachunku różniczkowym. Co to w praktyce oznacza? Że wygenerowane przez mojego rozmówcę odpowiedzi są wyliczone na podstawie wzorów i nie odzwierciedlają żadnej formy autonomicznych przemyśleń, a jedynie dotychczas istniejące zestawienia różnych sformułowań znajdujących się w olbrzymiej bazie danych, za pomocą których ChatGPT był (i wciąż jest) trenowany. Odpowiedzi, które dostaję, są więc zaledwie odpowiedziami prawdopodobnymi, o czym mogliśmy się przekonać podczas wysypu różnego rodzaju błędów, zwanych halucynacjami, które pojawiały się przy nawet najprostszych pytaniach. Miał więc rację Sidey Myoo [prof. Michał Ostrowicki], gdy zauważał: „Nie jest to sztuczność, ale zjawisko, w którym nie ma nic sztucznego. Kalkulator nie liczy sztucznie, podobnie jak wiele innych urządzeń nie zachowuje się sztucznie”[2]. Nie mamy do czynienia z nową formą inteligencji, a z programem, który wykorzystuje zettabajty już istniejących danych, wytwarzanych przez człowieka.

Osoby, które czytały „Cyberiadę” Stanisława Lema, znają to zjawisko doskonale. Świat robotów, w którym żyją Trurl i Klapaucjusz, został stworzony przez człowieka i posiada ograniczenia charakterystyczne dla ludzkiego umysłu: podlega zatem znanym nam zasadom, a zamieszkujące go postaci popełniają arcyludzkie błędy. Stąd bierze się irytacja głównych bohaterów – humanoidów – kiedy stworzony przez nich Elektrybałt (a więc maszyna poetycka) tworzy niezrozumiałe wiersze, a maszyna licząca uparcie twierdzi, że 2+2=7. Nie są bowiem w stanie zaakceptować rzeczywistości, w której takie „odstępstwo od normy” byłoby dopuszczalne. Tu również wszystko sprowadza się – jak w przypadku LLM – do wzorów matematycznych. Czytamy na przykład, że:

szczęście jest to ugięcie, a więc ekstensor metaprzestrzeni oddzielającej węzeł intencjonalnych kolineacyjnie odwzorowań od obiektu intencjonalnego przy warunkach granicznych ustawionych omega-korelacją w alfa-wymiarowym […] kontinuum agregatów subsolowych[3].

Dlaczego więc w ogóle prowadzić dalej rozmowę o przyszłości pracy ze „sztuczną inteligencją”, skoro wiem, że nie powie mi niczego oryginalnego? Otóż właśnie dlatego! Modele językowe korzystają z olbrzymiej ilości danych i opierają się na treściach już istniejących – oznacza to więc, że dialog ten w jakiś sposób odzwierciedla społeczne nastroje, obawy, nadzieje i spekulacje. Dodatkowo zaś ironicznym znajduję fakt, że wszystkie powyższe dotyczą właśnie automatyzacji i zastąpienia człowieka przez maszynę, więc to właśnie tę ostatnią najlepiej o nie zapytać. W tym kontekście odczytuję również scenę z reflektorami w spektaklu „The Employees” – choć rozmawiają w niej automaty, zostały w nich zakodowane ludzkie wyobrażenia czy uprzedzenia, od których nie są w stanie uciec.

M.M.: Skoro ma zmienić się sam koncept pracy, w jakim kierunku może on ewoluować?

ChatGPT: Ewolucja koncepcji pracy może być związana z różnymi czynnikami, a jednym z istotnych podziałów jest rozróżnienie między pracą a zatrudnieniem, które podkreśla zmiany w sposobie, w jaki ludzie angażują się w aktywność zawodową. Oto kilka kwestii związanych z tym rozróżnieniem:

1) Tradycyjne zatrudnienie vs. praca niezależna: W tradycyjnym podejściu do pracy ludzie są zatrudniani przez firmy na podstawie umów o pracę. Jednak coraz więcej osób decyduje się na pracę niezależną, freelancing lub prowadzenie własnej działalności gospodarczej. To zmienia koncepcję stabilności zatrudnienia i wprowadza elastyczne formy pracy.

2) Platformy i gig economy: Wraz z rozwojem technologii powstały platformy online, które łączą pracodawców z pracownikami na zasadzie projektów (gig economy). Ludzie mogą wykonywać krótkoterminowe zadania na żądanie, co zmienia tradycyjne modele zatrudnienia.

3) Praca zdalna: Technologie umożliwiają pracę zdalną, co oznacza, że ludzie nie muszą być fizycznie obecni w biurze. To wprowadza nowe wyzwania związane z organizacją pracy, ale także daje pracownikom większą elastyczność.

4) Równowaga między życiem zawodowym a prywatnym: Wiele osób dąży do osiągnięcia równowagi między pracą a życiem prywatnym. Koncepcja sukcesu zawodowego zaczyna być postrzegana przez pryzmat nie tylko osiągnięć zawodowych, ale także jakości życia ogółem.

5) Edukacja i rozwój zawodowy: Wraz z szybkim rozwojem technologii, nauka i rozwój zawodowy stają się kluczowymi elementami utrzymania konkurencyjności na rynku pracy. Ludzie mogą być zmuszeni do ciągłego doskonalenia swoich umiejętności, aby dostosować się do zmian.

Wszystko powyższe prowadzi do refleksji nad kwestiami, takimi jak elastyczność, autonomia, odpowiedzialność za karierę czy równowaga między życiem zawodowym a osobistym. Ewolucja koncepcji pracy będzie prawdopodobnie wynikiem wpływu tych czynników i wielu innych.

Rzeczywiście gig economy, znane w języku polskim jako ekonomia fuchy czy gospodarka chałtury, stało się powszechnym zjawiskiem, które zmieniło nasze podejście do zatrudnienia. Uberyzacja warunków tego ostatniego to wręcz prekariat na sterydach – szybkie, niezobowiązujące i niskopłatne kontrakty, które uzależniają ludzkość od platform o globalnym zasięgu, dostarczających przede wszystkim cyfrową infrastrukturę. Glovo, Uber, Bolt czy Airbnb to najwięksi dostawcy usług i pracodawcy, którzy niemal nikogo nie zatrudniają. Wręcz przeciwnie, podobnie jak w przypadku LLM, całą pracę – która ostatecznie służy nie tylko kapitalizacji zysku, ale również przyspieszeniu technologicznego rozwoju – wykonują tutaj ludzie korzystający z ich platform. Nie inaczej jest przecież z usługą oferowaną przez OpenAI. Choć ChatGPT dostępny jest zarówno w „darmowej”, jak i płatnej wersji, w rzeczywistości każda z nich wiąże się z kosztami, które musimy ponieść. Gdy w listopadzie 2022 roku platforma została uruchomiona, cały świat z wypiekami na twarzy zasiadł przed komputerami, by sprawdzić umiejętności, jakie posiadła tak zwana sztuczna inteligencja. W efekcie staliśmy się niepłatnymi testerami, o których każdy pracodawca mógłby tylko marzyć. Każda osoba za pomocą odpowiedniej ikonki może ocenić odpowiedź wygenerowaną przez ChatGPT bądź zasugerować ulepszenia, dzięki czemu model podlega nieustannemu treningowi na masową skalę. OpenAI nie musi za to nikomu płacić, a nawet może na tym zarobić, ponieważ dokładnie tak samo działa wersja oparta na płatnej subskrypcji – są więc osoby, które płacą za to, by móc trenować ChatGPT, łudzone dostępem do jego lepszej wersji (na którą sami pracują). Jak zauważa Michał Krzykawski, „mówi się, całkiem słusznie, że surowcem kapitalizmu są dane. Ale na głębszym poziomie tym surowcem jesteśmy my”.

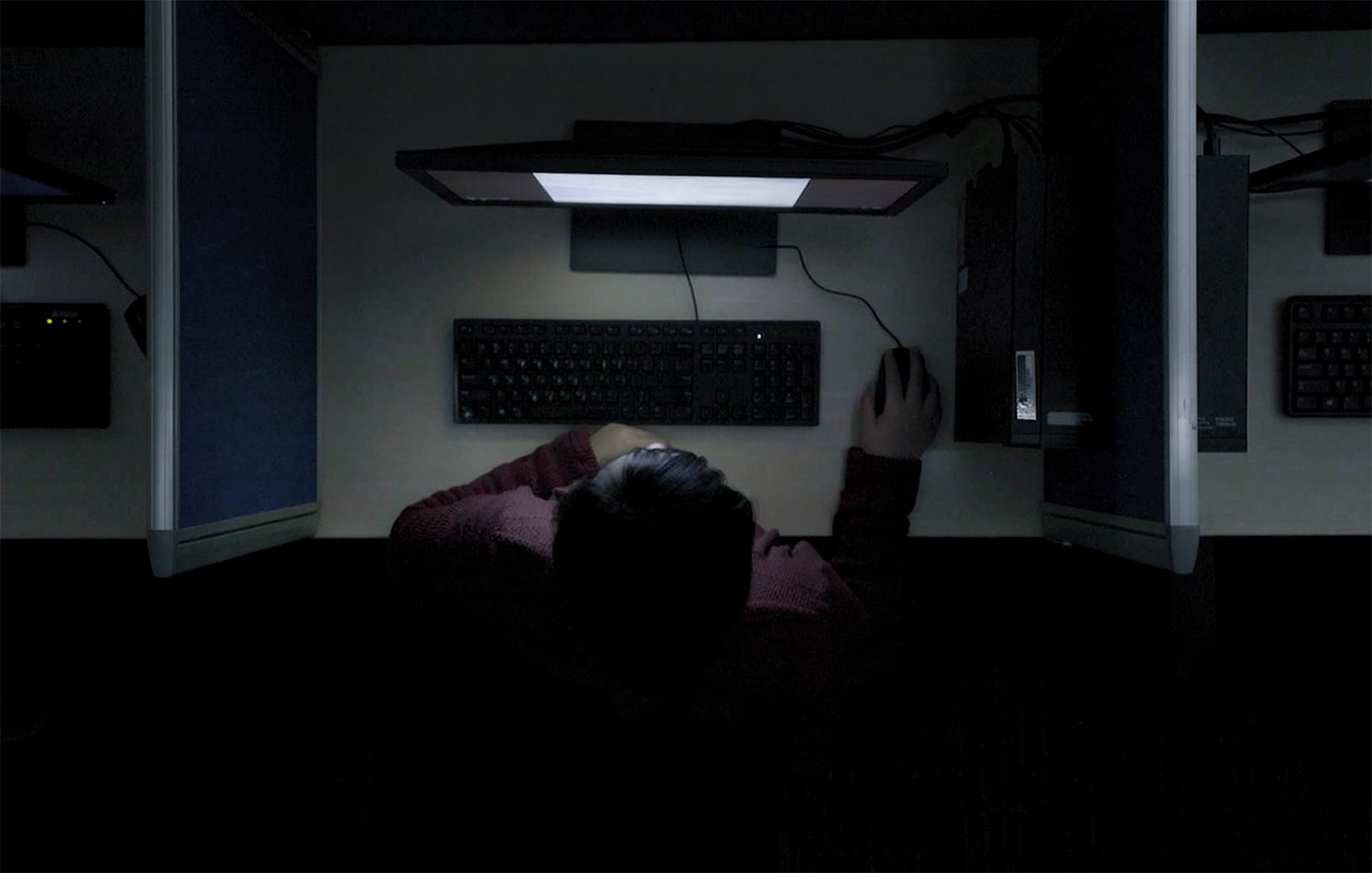

Nie można również zapominać o tej części wykonywanej przez ludzi pracy, która pozostaje nie-obecna w rzeczywistości wielkich platform. Jak ustalono w ramach dziennikarskiego śledztwa, o którego wynikach poinformowano na łamach magazynu „Time”, firma OpenAI zatrudniała osoby z Kenii, którym płaciła niecałe 2 dolary za godzinę przesiewania toksycznych treści na potrzeby baz danych swojego flagowego LLM. Nie inaczej postępują platformy mediów społecznościowych, zatrudniające za najniższe stawki między innymi osoby z Filipin, których zadaniem jest sprawdzanie materiałów oznaczonych (zarówno przez użytkowników oraz użytkowniczki, jak i przez algorytm) jako drastyczne, zawierające przemoc czy obraźliwe. O tragedii tych ludzi, którzy przez długi czas nie mogą pozbyć się oglądanych godzinami obrazów sprzed oczu, opowiada dokument Moritza Riesewiecka i Hansa Blocka „Czyściciele internetu” (2018), pokazujący, jak Manila stała się światowym składowiskiem nie tylko śmieci elektronicznych, ale również cyfrowych.

Możemy więc powiedzieć, że ludzka praca w kontekście rozwijającej się technologii oraz komputacyjnej automatyzacji staje się nie-obecna. Używam tego określenia na oznaczenie szczególnego typu aktywnej nieobecności, która bierze się przede wszystkim z (świadomego bądź nie) niedostrzegania fundamentalnych problemów współczesności, pracujących na rzecz pogłębiania się trawiących świat kryzysów. Fakt pozostawiania tej pracy poza zasięgiem naszego wzroku (owo zaślepienie ma charakter systemowy) nie oznacza, że jest ona nieobecna. Wręcz przeciwnie, to właśnie jej aktywny charakter, pomimo pozornej nieobecności, doprowadza do obecności efektów owego uniewidocznienia.

Zaproponowany przez mojego rozmówcę podział na pracę i zatrudnienie przypomina ten, o którym pisał Bernard Stiegler – nawet jeśli francuski filozof rozumiał go inaczej. Dla Stieglera różnica ta była istotna dla zrozumienia współczesnych wyzwań społeczno-ekonomicznych. Analizował on pracę i zatrudnienie jako procesy w których jednostki angażują się w interakcję z technologią. Praca w takim ujęciu oznacza aktywność kształtującą narzędzia, kulturę i środowisko, podczas gdy zatrudnienie to formalna organizacja tej pracy w ramach instytucji społecznych, takich jak przedsiębiorstwa. Autor „Wstrząsów” zauważał, że w wyniku uprzemysłowienia jednostki są oddzielone od aktywności twórczej, a ich praca staje się bardziej zorganizowana i scentralizowana w ramach struktur zatrudnienia, co prowadzi do utraty kontroli nad jej procesami, a w efekcie do społecznej alienacji. Stiegler utożsamiał pracę z kulturowym wymiarem ludzkiego istnienia – polega ona nie tyle na wykonywaniu czynności, ile na wytwarzaniu znaczeń, wartości, a nawet tożsamości. Oparcie się wyłącznie na zatrudnieniu może prowadzić do utraty sensu pracy, do alienacji i dehumanizacji. Według filozofa przyszłość pozbawiona zatrudnienia byłaby jednak trudna do osiągnięcia, jako że obecne struktury społeczno-ekonomiczne są głęboko zakorzenione w tej idei. Wskazywał on jednak na potrzebę rewizji obecnych form zatrudnienia i społecznych konwencji pracy, które należałoby przeprowadzić w sposób holistyczny – obejmujący transformację systemów edukacji, przemyślenie modeli gospodarczych czy bardziej zrównoważony i humanistyczny sposób korzystania z technologii. Co ciekawe, ChatGPT – nawet jeśli tego nie wie – sugeruje całkiem podobną wizję przyszłości.

M.M.: Jak w takim razie postrzegasz swoją rolę w kontekście przemian modeli pracy, o których tutaj mówimy i jej przyszłości?

ChatGPT: Jako sztucznej inteligencji, stworzonej do wspierania ludzi w różnych zadaniach, w tym w udzielaniu informacji, generowaniu treści czy rozwiązywaniu problemów, moja rola może być w związku z przemianami modeli pracy i ich przyszłości postrzegana w kilku kontekstach:

1) Wsparcie w zadaniach rutynowych: Automatyzacja i rozwój sztucznej inteligencji mają potencjał znaczącego wpływu na eliminację rutynowych i powtarzalnych zadań. W tej roli mogę pomóc w uwalnianiu czasu ludzi, pozwalając im skoncentrować się na bardziej kreatywnych i strategicznych aspektach pracy.

2) Tworzenie treści i edukacja: W kontekście ewolucji pracy opartej na wiedzy moja zdolność do generowania treści edukacyjnych i informacyjnych może wspierać procesy uczenia się i dostarczania wartościowej wiedzy. To może mieć znaczenie w rozwijaniu umiejętności niezbędnych w przyszłym środowisku pracy.

3) Wspieranie innowacji: W kontekście kultury pracy opartej na współpracy i innowacjach moja rola może polegać na dostarczaniu narzędzi i informacji, które pomagają w procesie tworzenia nowych rozwiązań, produktów czy usług.

4) Rozwijanie umiejętności interpersonalnych: Mimo że jako sztuczna inteligencja nie posiadam emocji, mogę być użyteczna w symulowaniu interakcji interpersonalnych, wspierając ludzi w rozwijaniu umiejętności komunikacyjnych, negocjacyjnych czy zarządzania konfliktami.

5) Odpowiedzialne i etyczne wykorzystanie technologii: W kontekście obaw związanych z etyką oraz moralnością w pracy z technologią, moja rola obejmuje także promowanie odpowiedzialnego i etycznego wykorzystania sztucznej inteligencji. To wymaga ścisłej zgodności z zasadami prywatności, uczciwości i poszanowania dla różnorodności.

Jednakże ważne jest podkreślenie, że moja rola jako sztucznej inteligencji jest uzupełniająca wobec ludzi. Wspieram, ułatwiam zadania, ale decydujące znaczenie ma zawsze ludzka kreatywność, empatia, moralność i zdolność do podejmowania decyzji. Współpraca między ludźmi a technologią, oparta na wzajemnym szacunku i zrozumieniu, jest kluczowym elementem tworzenia przyszłości pracy, w której obie strony wzajemnie się uzupełniają.

Nie jestem w stanie powiedzieć, jaka będzie przyszłość pracy. Nie wie tego również tak zwana sztuczna inteligencja (która w ogóle, choć może posiadać sporą bazę informacji, niewiele wie). Wiem jednak, że praca, która nadchodzi, będzie wymagała od nas przede wszystkim wypracowania szczególnych form współ-pracy. Nie jesteśmy w stanie zresetować rozpędzonej technologii, która przejmuje część naszych zadań, wypierając z niektórych form zatrudnienia nie tylko człowieka, ale również starsze wersje oprogramowania. Nie jest to jednak zjawisko nowe, a wręcz przeciwnie – znane nam już od czasów rewolucji agrarnej. Jak w przywoływanym już artykule zauważał Krzykawski, nie chodzi również o adaptację, która w obecnych czasach stała się nowym imperatywem politycznym. Wręcz przeciwnie – to nie my powinniśmy się dostosowywać do zmieniającej się rzeczywistości. Winniśmy raczej przypomnieć sobie, że to my tę zmianę wytwarzamy, nawet jeśli niełatwo nam to zauważać. Nie ma pracy przyszłości bez obecności człowieka, tak jak i trudno ją sobie wyobrazić bez technologii. To jednak wciąż jedna praca, którą współdzielimy. Być może powinniśmy więc poszukiwać takich form technologicznego rozwoju, które pozwolą na kreatywne wykorzystanie maszyny, a nie jedynie automatyzację, która niesie ze sobą powtarzalność i opiera się na przewidywalności.

Jeden z bohaterów dokumentu „Świat po pracy” (reż. Erik Gandini, 2023), opowiadającego o zachodzących współcześnie przemianach tego zjawiska, pyta z przekąsem w kontekście problemu automatyzacji i utraty zatrudnienia: „A może praca nie powinna być fajna?”. Pozwolę sobie jednak zapytać odwrotnie: a co, jeśli praca przyszłości mogłaby być fajna? Gdybyśmy mogli uniknąć w niej narzekania na warunki zatrudnienia, na jej zasadność? Gdybyśmy dostrzegali głęboki sens tego, co robimy? Może to naiwne, ale jestem przekonany, że jest to możliwe, jeśli przyszłością pracy uczynimy współ-pracę.